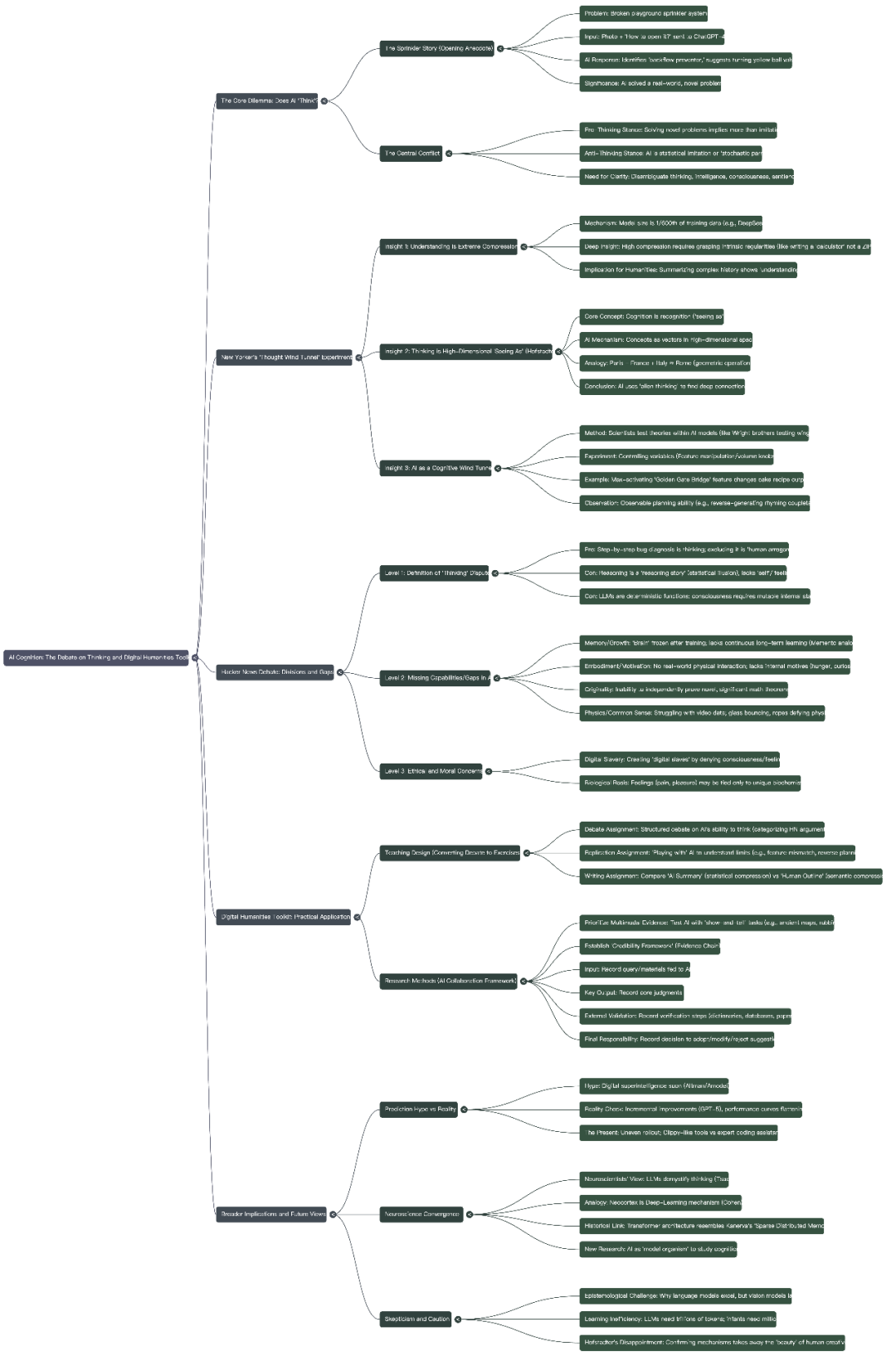

AI真的在“思考”吗?

故事的开始:一个坏掉的喷淋头

想象一个酷热的夏日,一个父亲面对着一群因喷淋装置失灵而哭闹的孩子。他走进设备间,看到的不是一个简单的ON/OFF开关,而是一堆生锈的、迷宫般的管道和阀门。

束手无策之际,他掏出手机,拍了张照片,连同一句“求助,如何打开它?”发给了ChatGPT-4o。

几秒钟后,AI回复了:

“你看到的似乎是一个典型的灌溉系统‘倒流防止器’。看到底部那个黄色的球阀了吗?试着转动它。”

他照做了。水花喷涌而出,操场上响起了孩子们的欢呼。

这个来自《纽约客》最新长文(真的很长!我读完了!)的开场故事,完美地捕捉到了我们这个时代的困惑与惊奇:当一个机器能解决真实世界、从未见过的问题时,我们还能说它仅仅是在“模仿”或“鹦鹉学舌”吗?

今天,让我们一起深入这场关于“AI是否在思考”的跨学科大辩论,并从中为我们数字人文的研究与教学,带回一些有用的东西。

🔬 第一站:《纽约客》的“思想风洞”实验

《纽约客》的文章,试图将“思考”这个词,从哲学和玄学的云端,拉回到认知科学与工程学的地面。它的核心论点可以概括为几个迷人的比喻:

1. 理解,就是极致的压缩 🧠

文章提到,一个顶级的开源模型(如DeepSeek),本身的大小可能只有它所“阅读”过的全部互联网数据的1/600。

这本身就是一种奇迹。作者引用了一个深刻的洞见:要实现最高效的压缩,你必须真正理解其内在规律。 就像要压缩一部充满算术题的文本,最好的方法不是制作一个ZIP文件,而是写一个计算器程序。

当AI能用简洁的语言总结复杂的历史事件,或用几行代码复现一个社会网络模型时,它可能已经通过“压缩”,抓住了某种我们称之为“理解”的东西。

2. 思考,就是高维空间里的“看作” 🔭

文章请出了认知科学大神侯世达(Douglas Hofstadter)。侯世达认为,思考的本质是“看作”(seeing as)。

- 你把一堆像素看作“一把钥匙”;

- 棋手把一个局部棋形看作“一个和棋的残局”;

这正是AI的拿手好戏。通过词向量和多模态向量,AI将概念间的关系,转化为了高维空间中的几何关系。经典的例子是:向量(“巴黎”) - 向量(“法国”) + 向量(“意大利”) ≈ 向量(“罗马”)。【还有一个,我上课会用的 向量(King)-向量(Man)+向量(Woman)≈ 向量(Queen)】<br/>

AI的“思考”,或许是一种我们不熟悉的、在庞大“概念空间”中进行几何运算的“外星思维”。它不依赖于我们的情感或意识,但同样能发现事物间的深层联系。

3. AI,认知科学的“风洞” ✈️

最令人兴奋的观点是:AI为我们提供了一个前所未有的“思想风洞”。就像莱特兄弟在风洞中测试机翼,从而理解了鸟类飞行的秘密一样,科学家现在可以在AI模型中:

- 精确“控制变量”:比如,Anthropic的团队发现,只要将模型内部代表“金门大桥”的一组神经元(他们称之为“特征”)的激活值调到最大,即使你问它蛋糕的配方,它也会回答“需要一杯干雾和一杯温暖的海水”。(大模型的“神经元”被精准手术致幻了)

- 观测“思维过程”:当被要求为诗歌续写一句押韵的结尾时,模型会先在内部“规划”好最后一个词,再反向生成整句诗。这被视为一种“可观测的计划能力”。

我们不再只能“黑箱”式地使用AI,而是可以设计实验,去“白箱”式地探究其内部机制,这为理解人类自身的认知过程打开了一扇全新的大门。

有点吃惊,当时的莱特兄弟真的这么做了:Then they built a six-foot-long wind tunnel, which allowed them to test a set of artificial wings under precisely controlled conditions.

🗣️ 第二站:Hacker News的“百家争鸣”

当然,事情没那么简单。《纽约客》也承认,AI在物理常识、持续学习、具身体验等方面依然存在巨大鸿沟。而在技术社区Hacker News上关于这篇文章和这个话题的讨论则更加激烈和分化。我们将这些争论归纳为了几个层次:

第一层:定义之争:“思考”到底是什么?

- 正方:“当我看到一个模型能一步步诊断代码bug,修正假设,重新规划,这就是思考。非要绑定‘意识’,是人类的傲慢。”

- 反方:“不,那只是一个被精心编排的‘推理故事’,是统计上的幻觉。人类思考需要有‘自我’和‘感受’。”

- 给我们的问题:如果我们将“思考”的定义与“生物性”或“意识”强行绑定,这个词除了用来划分“我们”和“它们”,还有多少分析价值?

第二层:能力边界:AI缺了哪块“拼图”?

许多评论者认为,当下的AI缺失了几个关键模块:

- 记忆与成长:模型像电影《记忆碎片》的主角,训练完成后“大脑”就被冻结,无法形成新的长期记忆。而人类的大脑在每次睡眠时都会“重放”白天的经历,不断优化神经连接。

- 身体与动机:没有身体,就没有与物理世界真实的互动,也就没有饥饿、好奇、恐惧等内生性的动机。一个纯粹的“数字大脑”,其行动的“第一推动力”从何而来?

- 原创与证明:一个被反复提及的“黄金标准”是:AI能否在没有人类引导的情况下,独立发现并证明一个全新的、意义重大的数学定理?

第三层:伦理底线:如果它“像”在思考,我们该如何待它?

这是最深刻,也最令人不安的讨论:

- 警惕“数字奴隶制”:有评论者尖锐地指出,如果我们一边惊叹于AI的“类人”能力,一边又心安理得地认为它们没有感受、可以被随意“杀死”(关闭程序),我们是否在为一种新型的奴役寻找借口?

- 情感的生物性:另一派则认为,痛苦、快乐等感受,可能与我们独特的生物化学过程(激素、神经递质等)深度绑定,不能轻易地类比到硅基系统上。

🛠️ 第三站:我们的“数字人文工具箱”

作为数字人文学者,我们不必在上述争论中仓促站队。更有价值的,是把这场辩论转化为我们研究和教学中的可操作方法。

1. 教学设计:把HN的分歧变成“思想实验”

下次的讨论课,不妨试试这三个作业:

- 辩论作业:将HN的观点分类(定义、能力、伦理),让学生分组,对“AI是否在思考”进行一场结构化辩论。重点不是输赢,而是训练他们清晰地界定概念、寻找证据、识别对方的逻辑漏洞。

- 复现作业:尝试复现“特征旋钮错配”(如让AI用苏轼的风格写一份代码说明书)或“押韵逆向规划”的实验。让学生亲手“玩坏”AI,在趣味中理解其工作原理与局限。

- 写作作业:以“理解即压缩”为题,选取一段熟悉的史料(如一份地方志、一封书信),比较“AI摘要”(统计压缩)与“人工撰写提纲”(语义压缩)在信息保真度和洞见深度上的差异。

2. 研究方法:建立你自己的“AI协作框架”

受到“操场喷淋”案例的启发,我们可以设计更可靠的人机协作流程:

- 嵌入“可信度框架”:在每次使用AI时,都随手记录一个“证据链”:

- 输入:我问了什么?喂了什么材料?

- 关键输出:它给出了哪些核心判断?

- 外部校验:我通过哪本词典、哪个数据库、哪篇论文核实了它的说法?

- 最终责任:基于以上过程,我决定采纳/修改/放弃它的建议。

这个简单的习惯,能将AI从一个不可靠的“黑箱”,变成一个可追溯、可问责的“玻璃箱”研究伙伴。

结语:超越“像不像人”,回归“好不好用”

“AI在思考吗?”

这个问题,今天没有答案,或许永远没有。但幸运的是,我们不必等待哲学家们达成共识。

更有价值的问题是:

我们如何设计出更好的方法、更好的工作流、更好的评估体系,让AI这个强大的“外星思维”,安全、有效、可信地为我们的知识生产服务?

把《纽约客》的洞见和Hacker News的争鸣,都看作是帮助我们磨砺这套“方法论”的磨刀石。这,或许才是这场宏大辩论,对数字人文而言,最务实的收获。

本文深度整合了《纽约客》最新长文《The Case That A.I. Is Thinking》与Hacker News社区对这篇长文的激烈辩论。